- Comment l’intelligence artificielle a changé et peut encore changer nos vies ?

- Il faut toujours réfléchir par domaines, l’intelligence artificielle s’applique à tout un peu comme l'électricité. Aujourd'hui, par exemple, il y a des systèmes d’intelligence artificielle qui lisent les scanners médicaux ou donnent un diagnostique médicale. La reconnaissance faciale garantit la sécurité dans les aéroports. Lors de recrutements, quand des milliers de gens postulent pour un seul poste il y a d'abord un robot, un agent conversationnel, qui fait les premières entretiens , etc…. On peut multiplier les exemples, l’intelligence artificielle c’est un outil qui se déploie à-peu-près dans tous les secteurs de notre vie. Elle a changé et elle pourra, évidement, encore changer nos vies.

- Le rythme des évolutions technologiques s’accélère. À quoi devons-nous nous attendre ?

- Les concepteurs de ces systèmes ont en tête une fin utile, il y a toujours de l’utilitaire aux cherchés mais il y a aussi des effets secondaires et nous devons faire preuve de prudence. Il faut se dire qu’il y aura toujours de l’imprévu, il y aura toujours des effets auxquels on n’avait pas pensé. Par exemple : la reconnaissance faciale. Tout le monde sait que son emploi est utile pour la sécurité publique mais il y a un vrai enjeu de protection de la vie privée et des données personnelles et donc il y a toujours des questions qui apparaissent en cours de route auxquelles on n’avait pas pensé dans la phase de conception du système. La vigilance est de mise parce et il faut modifier, rectifier le tir si nécessaire…

- Quelles sont les technologies qui présentent potentiellement un grand risque pour les êtres humains ?

- Cela dépend des pays et des civilisations, la question du risque est relative à notre conception du risque. Évidement si on parle de risque pour les êtres humains ou du risque biologique, là tout le monde est d’accord, mais par exemple la question de la protection des données personnelles qui est prépondérante pour la société française, est secondaire dans d'autres pays du monde. Ici on apprend aux enfants à l’école à se soucier de protéger leur vie privée mais ce n'est pas partout pareil.

Ainsi les grandes corporations de fabricants de systèmes d’intelligence artificielle qui sont principalement américains ou chinois n’appliquent pas forcément les même valeurs culturelles qu'on peut trouver dans d'autres civilisations...ça aussi c’est une question importante qui peut présenter un risque...

- Quelle ligne, selon vous, ne doit jamais être franchie ? Comment éviter les dérives éthiques ?

- Il y a un exemple que he cite tout le temps à mes étudiants : à la fin du 19ème siècle quand le téléphone filaire est arrivé en Suisse, ils étaient nombreux à penser que cet outil aurait changé à jamais les habitudes et que les gens n’iraient plus se voir, se rencontrer. Plusieurs villes à l’époque ont décidé de ne pas installer de réseaux téléphoniques pour le faire quelques temps après parce que ils avaient compris que le contact téléphonique était tout de même un contact humain. Certes different mais toujours humain. Aujourd’hui, comme à l’époque, la norme de ce que c’est un bon contact humain a évolué. De la même manière les lignes rouges d’aujourd’hui ne seront plus si rouges que ça dans 20 ou 30 ans.

La voiture autonome par exemple n’a pas la même réception en Europe que aux Etats Unis, ici on se pose beaucoup de questions alors que les Américains ou les Chinois l’utilisent déjà dans plein de villes...peut être que cette conception évoluera...

Les lignes rouges je n’y crois pas mais les lignes relatives à une génération ou une civilisation…ça oui, certainement. Mais elle peuvent évoluer et il faut donc les faire évoluer. - Entre l’homme et la machine qui va gagner ?

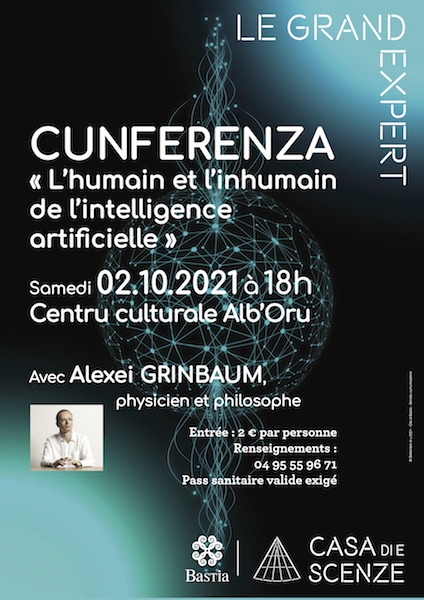

- C'est le thème en quelque sorte de ma conférence de Bastia. Au dé-là de la fiction où à tour de rôle c'est l'homme ou la machine qui remporte la bataille, dans la vie réelle c’est une imitation mutuelle. Les machines apprennent en regardant comme ils font les hommes, elles nous imitent. Mais les utilisateurs (l'homme) imitent le comportement des machines. Sauf que dans le comportement des machines il peut y avoir des traits inhumaine. Les machines ne reconnaissent pas les images comme nous par exemple et le risque c'est de faire notre un comportement qui est ’inhumain à travers l’imitation.

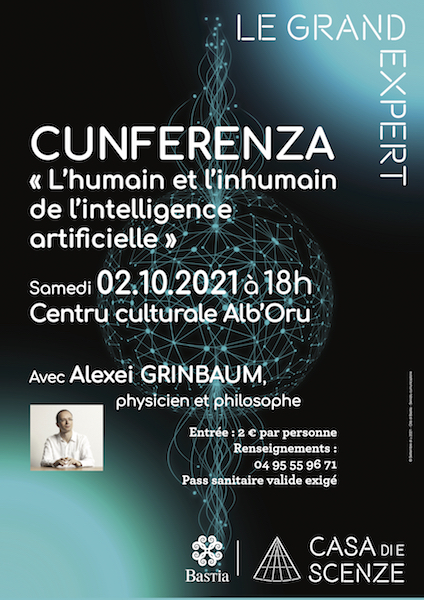

Pour débattre avec Alexeï Grinbaum autour de ce sujet, rendez-vous ce samedi à l'Alb'Oru à 18 heures

- Il faut toujours réfléchir par domaines, l’intelligence artificielle s’applique à tout un peu comme l'électricité. Aujourd'hui, par exemple, il y a des systèmes d’intelligence artificielle qui lisent les scanners médicaux ou donnent un diagnostique médicale. La reconnaissance faciale garantit la sécurité dans les aéroports. Lors de recrutements, quand des milliers de gens postulent pour un seul poste il y a d'abord un robot, un agent conversationnel, qui fait les premières entretiens , etc…. On peut multiplier les exemples, l’intelligence artificielle c’est un outil qui se déploie à-peu-près dans tous les secteurs de notre vie. Elle a changé et elle pourra, évidement, encore changer nos vies.

- Le rythme des évolutions technologiques s’accélère. À quoi devons-nous nous attendre ?

- Les concepteurs de ces systèmes ont en tête une fin utile, il y a toujours de l’utilitaire aux cherchés mais il y a aussi des effets secondaires et nous devons faire preuve de prudence. Il faut se dire qu’il y aura toujours de l’imprévu, il y aura toujours des effets auxquels on n’avait pas pensé. Par exemple : la reconnaissance faciale. Tout le monde sait que son emploi est utile pour la sécurité publique mais il y a un vrai enjeu de protection de la vie privée et des données personnelles et donc il y a toujours des questions qui apparaissent en cours de route auxquelles on n’avait pas pensé dans la phase de conception du système. La vigilance est de mise parce et il faut modifier, rectifier le tir si nécessaire…

- Quelles sont les technologies qui présentent potentiellement un grand risque pour les êtres humains ?

- Cela dépend des pays et des civilisations, la question du risque est relative à notre conception du risque. Évidement si on parle de risque pour les êtres humains ou du risque biologique, là tout le monde est d’accord, mais par exemple la question de la protection des données personnelles qui est prépondérante pour la société française, est secondaire dans d'autres pays du monde. Ici on apprend aux enfants à l’école à se soucier de protéger leur vie privée mais ce n'est pas partout pareil.

Ainsi les grandes corporations de fabricants de systèmes d’intelligence artificielle qui sont principalement américains ou chinois n’appliquent pas forcément les même valeurs culturelles qu'on peut trouver dans d'autres civilisations...ça aussi c’est une question importante qui peut présenter un risque...

- Quelle ligne, selon vous, ne doit jamais être franchie ? Comment éviter les dérives éthiques ?

- Il y a un exemple que he cite tout le temps à mes étudiants : à la fin du 19ème siècle quand le téléphone filaire est arrivé en Suisse, ils étaient nombreux à penser que cet outil aurait changé à jamais les habitudes et que les gens n’iraient plus se voir, se rencontrer. Plusieurs villes à l’époque ont décidé de ne pas installer de réseaux téléphoniques pour le faire quelques temps après parce que ils avaient compris que le contact téléphonique était tout de même un contact humain. Certes different mais toujours humain. Aujourd’hui, comme à l’époque, la norme de ce que c’est un bon contact humain a évolué. De la même manière les lignes rouges d’aujourd’hui ne seront plus si rouges que ça dans 20 ou 30 ans.

La voiture autonome par exemple n’a pas la même réception en Europe que aux Etats Unis, ici on se pose beaucoup de questions alors que les Américains ou les Chinois l’utilisent déjà dans plein de villes...peut être que cette conception évoluera...

Les lignes rouges je n’y crois pas mais les lignes relatives à une génération ou une civilisation…ça oui, certainement. Mais elle peuvent évoluer et il faut donc les faire évoluer.

- C'est le thème en quelque sorte de ma conférence de Bastia. Au dé-là de la fiction où à tour de rôle c'est l'homme ou la machine qui remporte la bataille, dans la vie réelle c’est une imitation mutuelle. Les machines apprennent en regardant comme ils font les hommes, elles nous imitent. Mais les utilisateurs (l'homme) imitent le comportement des machines. Sauf que dans le comportement des machines il peut y avoir des traits inhumaine. Les machines ne reconnaissent pas les images comme nous par exemple et le risque c'est de faire notre un comportement qui est ’inhumain à travers l’imitation.

Pour débattre avec Alexeï Grinbaum autour de ce sujet, rendez-vous ce samedi à l'Alb'Oru à 18 heures

Qui est Alexeï Grinbaum ?

Chercheur au laboratoire LARSIM (Laboratoire des recherches sur les sciences de la matière, qui mène des recherches en philosophie des sciences et des études sur les relations science-société) à l’IRFU (Institut de recherche sur les lois fondamentales de l’Univers) au CEA (Commissariat à l’énergie atomique et aux énergies alternatives) à Saclay. I so travaglii tràttanu di i fundamenti di a fìsica è di quistione ètiche di e tecnulugìe nove. Dipoi u 2003, Grinbaum s’interessa à e quistione ètiche in leia cù e tecnulugìe nove, anzituttu cù e nanotecnulugìe, cun l’intelligenza artifiziale è cù a rubòtica. Hè statu cuurdinatore pè a Francia di l’Usservatòriu eurupèu di e nanotecnulugìe è partinàriu di u prugettu « Recherche et innovation responsables en pratique » (RRI-Practice). Grinbaum hè à l’urìgine di una metudulugìa fundata nant’à i raconti pè un’avvicinera innuvativa di u prublema di a respunsabilità di u circatore. Membre du Comité national pilote d’éthique du numérique (CNPEN) et de la Commission d’éthique de la recherche en numérique (Cerna), il a publié « Mécanique des étreintes » (Encre Marine, 2014) et «!Les robots et le mal » (Desclée de Brouwer, 2019).

Alexeï Grinbaum

-

SC Bastia relégué en Ligue 3 après le chaos de Furiani

-

À Ajaccio, Kaylia Nemour fait rêver toute une génération

-

Rugby régional - Les cadets Cismonte en 8es de finale

-

Handball N2 - Corte-Ile-Rousse renverse Guilherand-Granges (30-28)

-

À Barbaghju, des citoyens formés au secours pour renforcer la résilience locale

Envoyer à un ami

Envoyer à un ami Version imprimable

Version imprimable